素人が生成AIについて理解できたことをまとめてみた

Back to Topこの記事は夏のリレー連載2025 5日目の記事です。

最近の生成AI技術の進歩は目覚ましく、「AI?ああスター〇ォーズの金色のロボットでしょ[1]」なレベルの認識しかない筆者であってもそれなりにAIを利用して作業ができるようになってきました。

分かっていなくても使えるということは素晴らしい進化だとは思いますが、この業界、すなわち生成AIの技術やそれを活用した仕組みを提供する可能性がある側で仕事をするにあたっては大まかな枠組みだけであっても頭に入れておいたほうが良いですよね。

生成AIについての情報は世に多いですが、素人にも分かり易く[2]概念を説明するような情報に辿り着かなかったこともあり、筆者は初期の学習に苦労しました。そこで、現時点で理解できたことをベースに「なんとなく生成AIの世界観がイメージできる」ところを目指してまとめてみたいと思います。

もちろん素人である筆者が公開情報などをもとに学習した内容のまとめですので、正確さに欠ける内容であったり誤解に基づいた内容が含まれるかもしれません。当然のこととして記事の文責は筆者にあります。

はじめに:そもそも生成AIって何なのさ

#AIという単語はよく使われますが、「何がAIで何がAIではないか」「なぜその両者に違いがあるのか」といった問いかけに対して厳密な解答ができるひとは少ない(いない?)のではないかと思っています。

AIという概念自体はかなり古く、100年近く前、機械による計算ができるようになった頃に遡ります。映画「イミテーション・ゲーム」の題材にもなった暗号解読機を生んだアラン・チューリングや初期のコンピュータ理論を構築したジョン・フォン・ノイマンなどの先人の時代から、「人間の知的活動」を機械に行わせる試みが行われてきました。そして1965年のダートマス会議と呼ばれる研究発表会で、ジョン・マッカーシーが“Artificial Intelligence (人工知能)”という表現をしたのがAIという単語の出自と言われています。

筆者の解釈ですが、AIとは「知能≒人間の知的活動」を代替する機械であることについて異論は無いようです。しかし、何が「知能」であるかに関する厳密な定義は難しく、提唱者のマッカーシー教授自身も「知能を(人間の知能と結び付けることなく)厳密に定義する」ことが困難であると認めています。例えばキャッチボールをすることが「知能」によるものと言ったら文脈によっては違和感があるように、何が人口「知能」であるのかを正確に定めることが難しくなっていそうです。本稿の目的はAIを正確に定義することではありませんので、「人間の知的活動」全般を代替する機械(コンピュータ)がAIであるというとらえ方をしていただければ概念が捉えやすいのではないかと思います。

「人間の知的活動」全般と言ってしまうと領域が広大なため、人工知能学会では提供するAIマップβ2.0の中で以下イメージ図のようにAIの課題領域を分類しています。

キャッチボールの例で言うと、「白い球体がどんどん大きくなっている」のを認識して「ボールが飛んできている」のだと分析し、「ボールの到達位置」を予測して「グローブの位置」を制御する というように、知的活動は様々な側面を持ちます。

生成AIとは生成・対話系の課題領域を中心とした[3]機能を持つAIであり、特に「新しいもの(文章、画像、データなど)」を作り出すことができるという意味で人間の「知的労働」を代替できるのではないかと強く期待[4]されています。

生成AIを支える技術

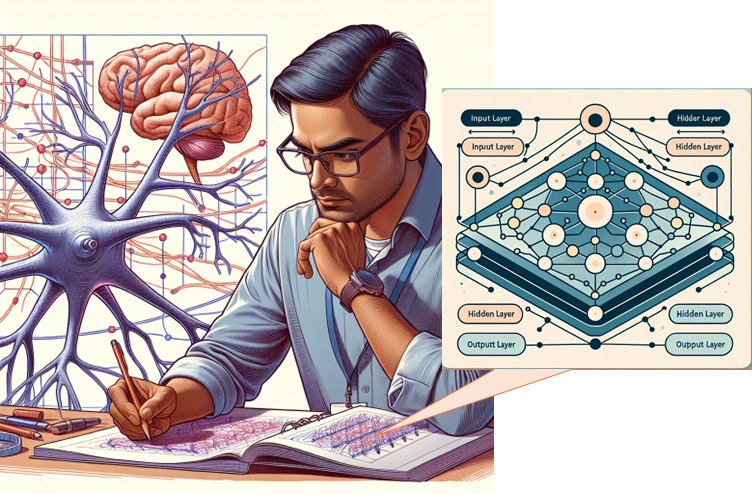

#AIの概念が生まれた時期に「人間の脳細胞の働き」を機械で再現するニューラルネットワークというアイデアが提唱されています。人間の脳細胞(ニューロン)は「複数の電気信号による入力を受けて次の脳細胞に信号を伝達する」ことを繰り返して活動することが分かっていました。そこで「複数の入力をもとに出力する」ニューロンのモデルをネットワークのように組み合わせることで脳機能を再現しようとする試みです。

構築されたニューラルネットワークはある入力に対して出力を行い、出力に応じてネットワークを調整していくことで「正しい≒人間が期待する」結果を出力できるようにパラメータを調整していくことができます。ちょうど人間が試行錯誤しながら知識を習得していくように、この調整段階をAIの「学習」と呼びます。

ニューラルネットワークは脳の仕組みを再現しようとする試みのため、どのようなモデルで脳の働きを表すのかによって様々な種類[5]のものがあります。どのようなモデルを採るかによってその特性は変わりますが、いずれにしろネットワーク状のモデルですからコンピュータの演算量は多くなる傾向があり、コンピュータ性能による限界もあってブームと衰退を繰り返す形で進歩してきました。

2017年にGoogleの研究者によって発表されたトランスフォーマー[6]というモデルは、それまでのモデルと異なり系列データの関係性を評価するのに「アテンション」というメカニズムを採用しました。これは機械翻訳などの入力から別の系列の出力を作成する「系列変換」の性能を改善することを目指したもので、それまでのアプローチと異なり膨大な入力に対しても関係性を評価できることで自然な(妥当な)出力が可能という特色を持っていました。この大量の情報に対しても関係性を評価できる特色は、コンピュータ側の性能進化とも相まって生成領域で活用されていくことになります。生成AIの火付け役の一つであるOpenAIのGPT(Generative Pre-trained Transformer)もトランスフォーマーの派生モデルの一つです。

入力に対して妥当な出力が可能になるということは、予め様々な情報を事前学習をさせておくことで「新しい」妥当な出力をAIが生成できるようになるということでもあります。例えばベートーベンの曲を大量に学習した人が、「ベートーベンが作曲したような[7]」新しい曲を作れるようなものでしょうか。昨今の技術を利用してみた感想ですが、生成AIの出力はかなり人間の出力に近づいてきているものと思います。

生成AIの影響、そして限界

#生成AIが人間に近い知的作業を担えるようになったことで、「調べものをしてレポートにまとめる」とか「要求を分析して適した設計を行う」とか、これまで人間でないと難しかった作業をコンピュータが分担できるようになる可能性があります。人がやると時間がかかるような作業もかなりの速度で対応してくれる[8]ので、このような作業に関しては生成AIの活用によって生産性が飛躍的に向上できる可能性があるということです。

ただし、AIが出力する内容が「100%妥当」ということはありません。これはAIへの指示が悪かった[9]時によく感じることでもありますし、ハルシネーションと呼ばれる正確ではない情報の出力や、ミスアライメントと呼ばれる「悪い」AIの誕生があることなども報告されています。人間の脳をベースにした試みですので、人間と同じように「あいまいな指示だと上手く結果が出せない」ことや「見てきたような嘘をつい」たり「倫理に外れた言動を示す」ことがあるのは当然かもしれません。

知的労働を分担できるということは、人間の作業の一部分に関しては生成AIで代替される可能性があります。例えばILOのレポートでは雇用の1/4が影響を受けると報告されています。しかし、そのレポート中にも述べられていますが、人間の知的作業が完全に置き換わることは難しいようです。

前述のような技術的課題を乗り越えられるかに関しては専門家でないためなんとも言えない部分もありますが、技術的課題がなくなったとしてもAIが意思決定し得ないないという問題は残ると考えています。これはAI側の能力という技術的な問題ではなく、「AIが決定したこと」に対する責任の所在について合意が形成できていないという社会構造的な課題です。

人間個人であれば出したものの責任は当人になりますし、それが組織であれば組織(の責任者)のものになるというのが現在の社会の基礎[10]になっていると筆者は考えます。つまり、AIが出力した結果によって問題が発生した場合に「どのように責任がとられるか」が明確にならない限りAIは独立して人の作業を代替できないということです。遥か未来には「AIがやったことだからね」という合意がある世界が待っているのかもしれませんが、現時点の感覚では問題が起きた際にAIの責任として飲み込むことには強い抵抗があります。

AIとどう付き合っていくべきか

#筆者は軽く使ってみた程度の経験でしかないですが、現時点の状況では生成AIを「指示に従って妥当な出力をしてくれる機械」と捉えるよりも「(懸命に作業をしてくれる)新人さん」というくらいの位置づけで捉えるほうが良いように感じています。「明確な指示」を出せば結果を出してくれるけれども「間違い」をすることもあるからチェックは必要だし、間違えたときの責任は指示を出した側がとる必要がある、というとらえ方ですね。逆を言えば新人さんにお願いしていたような雑多な作業は生成AIが代替できる可能性があるとも言えます。米国などで知的労働市場でエントリーレベルの求人が減っている[11]というのは生成AIの台頭(あるいはその期待)の一つの証左かもしれません。

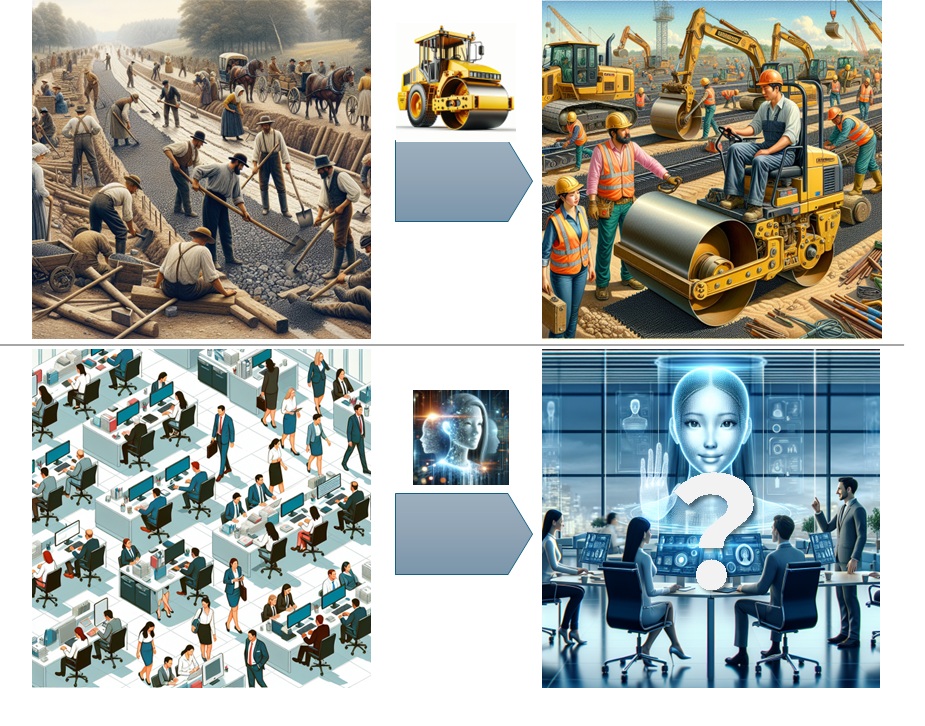

かつて産業革命においては蒸気機関や内燃機関などの機械動力によって労働集約型の業務は資本集約型の業務に転換されていきました。道路工事を例にとると、機械動力による生産性向上が大きいため、多くの労働力(労働者の肉体労働)を集めていたものが資本を集め(建設機械を導入し)て少ない労働力で実施する形に変わったということです。今後、知的労働についても同じような構造の変化が起きていく可能性は高いものと思います。

短絡的にみると、経験の浅い人間を減らして少人数の「ベテラン」だけで業務を行うことがもっとも効率が良さそうです。しかし、長い目で見れば「ベテラン」は時とともに引退していくものですから、事業の継続が難しくなることは明らかです。AIと分業していくことを踏まえたうえで人間が担う役割のスキルを成長させていくことが求められることになっていくでしょう。

重機を使った道路工事で言えば「どこを削りどこを埋めるかを決め」るところが人間、実際に「土を崩したり石を運んだりする」作業が機械、「問題発生時に対処を検討したり調整する」のが人間、と分業されています。おなじように知的労働においても、どのような形になるか見えていない部分も多いですが、人間がやらざるを得ない領域は残ることでしょう。ここで生成AIの「意思決定ができない」あるいは「責任がとれない」特色を踏まえると、これからの知的労働では「意思決定をして責任が取れる」ことが人間に求められるような気がします。

筆者は教育についても門外漢ではありますが、「深く考えて、自分の責任範囲の中で意思決定[12]してみる」ことが、あるいはそのような機会を提供することが、これからのキャリア形成において重要になっていきそうです。

まとめ

#生成AIについて背景から現時点での能力・将来の展望までを筆者の素人理解でまとめてみました。生成AIって興味はあるけど、、、のようなときに どなたかのお役に立てるようでしたら幸いです。

本稿では個別の技術情報についてはあまり触れられていませんが、当デベロッパーサイトでもこのリレー連載をはじめとして詳しい方がいろいろと発信してくれていますので興味が湧きましたらそちらも訪ねていただけると嬉しいです。

もしかすると通じないネタかもしれないですが、子供時代にテレビや映画でロボットが人間と会話している場面を見て「アレがえーあいってヤツなのかぁ」なんて訳も分からず納得した経験は誰にでもあるのではないかと思います。と、書いてみてSiriやAlexaをAIと呼ばないように、技術が普及したことにより かえって最近はAIという呼称を使うことが少なくなっているような気もしてきました。 ↩︎

例えば「生成AIとは深層学習技術によって既存データを学習し、より人間が生み出すものに近い形で新規のものを生み出す特色があります。」と言われてみても周辺の概念が分からない状態では「え、コンピュータが学習できるってどういうこと?」とか「深層学習と新しいものを生み出すってどう関係するの?」とか?マークがいっぱい並ぶだけですよね。(筆者はそうでした) ↩︎

ものを生成するにあたって入力情報の「分析」/「推定」や指示に応じた「設計」などの領域の機能も有しているように感じられます。が、概念をつかむにあたっては主に「生成」の機能を持つという理解で十分だと思います。 ↩︎

「知的労働を代替できるのではないか」という期待はAIの概念そのものです。筆者の肌感覚ですが、生成AIに対する期待の大きさは実際に知的労働に携わる人間が実際に置き換えられるのではないかという期待(あるいは危機感)を持っている点がこれまでの(いつかできるだろうという夢に近かった)AIへの期待と異なるように思います。 ↩︎

有名なところではネットワークを多層に重ねることでより深い学習(深層学習)を可能にしたディープニューラルネットワーク(DNN)、画像処理などに強みを発揮する畳み込みニューラルネットワーク(CNN)、時系列データを扱うことができるため文脈解釈などが可能な再帰的ニューラルネットワーク(RNN)などがあります。 ↩︎

「Attention Is All You Need」という映画か歌のタイトルのような論文ですが、その後のAIの進化に大きく寄与しており論文の引用数も非常に多いとのことです。 ↩︎

子供が作ったベートーベン風とプロの音楽家が作ったベートーベン風の完成度が違うように、作者の理解度によってどの程度妥当なものになるのかは変わってくるものと思います。人間の知能を模しているので当然ではありますが、生成AIにとってもどのように学習(成長)させるかが肝である辺りは興味深いですね。 ↩︎

お気付きかもしれませんが、本稿のイメージ図は生成AIを活用して作成しています。筆者が不慣れなことも手伝ってイラストとして「完全にイメージどおり」とまではいきませんでしたが、手作業で作成したとしたら数時間はかかるようなイラストが数分で作れてますのでその効果については論を待たないと思います。 ↩︎

生成AIを使ったことがある方はよくご存じかもしれませんが、「この文書を100字程度に要約して」のようにある程度明確な指示に対してはかなり良い結果を出してくれる印象です。しかし、「日本の戦国時代を良い感じに説明して」のように入力が膨大だったり要求が不明確だったりすると結果がぶれがちな印象です。 ↩︎

例えば子供の行為の責任は保護者も負う、万一のときのために保険をかけるなど、今の社会では個人がその能力で追える粒度に責任を分解しているように思います。社会科学の専門家でない筆者の感覚に過ぎませんが、第一義的には当事者が責任を取るというのが社会を成り立たせてる要素、つまりは発生した問題を周りが飲み込みうる理由のように感じます。 ↩︎

経済状況なども絡むので一概に「AIが仕事を奪った」と言うことはできないですが、単純業務や定型業務は生成AIで代替可能と捉えている経営者が一定程度いるとのことです。 ↩︎

たとえば会社員の立場であるなど、最終的な意思決定は難しい立場であることが多いとは思います。が、担当作業の範囲内などで「どう進める」かを検討/意思決定して上司の承認をもらいに行くような形であれば無理なく意思決定の経験ができるのではないでしょうか。 ↩︎